Apologie d'une politique d'intelligence artificielle éthique en Colombie

Santiago UribeSi les algorithmes des programmes d'IA permettent de traiter des milliers de variables et de calculer des millions de données, leur fonctionnement demeure opaque -et leur éthique aussi.

.jpg)

Fernando Botero, La rue, 2013, huile sur toile. Galerie Gmurzynska

L'IA est partout : des réseaux sociaux et services de streaming, aux points de contrôle d'immigration biométriques, en passant par les outils de diagnostic médical et les applications sur nos smartphones... En effet, les algorithmes et les programmes qui fonctionnent à l'aide de l'intelligence artificielle (IA) ont atteint une telle capacité cognitive que dans certains domaines, ils dépassent nos capacités humaines (jouer aux échecs, à détecter des tumeurs etc.). L'utilisation de ces technologies est devenue indispensable, transformant nos relations avec le numérique et la façon dont nous percevons le pouvoir des autorités publiques et les relations humaines. Le potentiel de transformation de l'économie, de l'innovation, du développement et des méthodes de travail qu'induit la technologie est tel que cette transformation numérique a été appelée la "quatrième révolution industrielle". Il n'est donc pas surprenant que le monde se tourne vers l'IA comme nouveau débouché économique prometteur de croissance. C'est notamment pour cela que l'on observe, au cours de ces dernières années, que les principales économies mondiales (Union européenne, États-Unis, Chine, etc.) ont élaboré des stratégies et des plans nationaux pour favoriser l'IA et innover dans ce domaine.

L'IA a le potentiel de transformer l'économie, d'attirer les investissements, de créer des emplois qualifiés, de vendre des services à des millions de personnes et de permettre l'accès à l'information et à d'autres avantages de la technologie. En Colombie, par exemple, les systèmes de surveillance biométrique, comme la reconnaissance faciale, ont amélioré la sécurité dans les lieux publics et les services de contrôle de l'immigration dans les aéroports. Pendant la pandémie de Covid-19, de tels systèmes d'IA ont été mis en place dans plusieurs pays pour détecter les personnes présentant des symptômes du virus. Les avantages sont sans aucun doute nombreux, mais ils ne sont pas sans risques.

Si les algorithmes exécutés dans les programmes d'IA sont efficaces pour traiter des milliers de variables et calculer des millions de données, leur fonctionnement demeure opaque par nature. En effet, il est impossible pour les utilisateurs comme pour les programmeurs de comprendre le processus employé par l'algorithme pour prendre des décisions (pourquoi A et pas B ?). D'autre part, les bases de données utilisées pour alimenter le programme risquent d'être incomplètes, biaisées, et donc de perpétuer de tels biais, et a fortiori, des situations discriminatoires.

Depuis 2019, la Colombie dispose d'une politique publique sur la transformation numérique et l'intelligence artificielle. Celle-ci vise à établir des conditions favorables à l'investissement dans le développement des technologies numériques. De même, en 2021, le gouvernement a élaboré le "Cadre éthique pour l'intelligence artificielle" qui vise à garantir l'utilisation éthique des algorithmes et à atténuer les risques liés à leur utilisation. En outre, depuis 2021, la "Mission d'experts sur l'intelligence artificielle" s'est donnée l'objectif de formuler des recommandations sur la manière dont la Colombie devrait promouvoir et mettre en œuvre l'IA dans le cadre de l'emploi et de la protection de l'environnement.

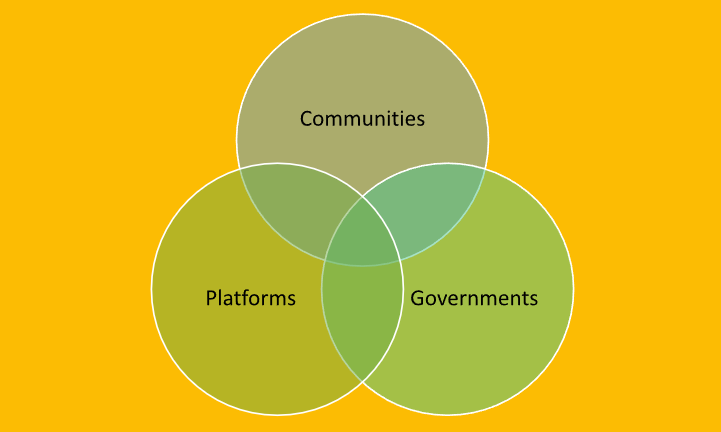

Mais l'intelligence artificielle, en théorie un outil infaillible et créateur de valeur ajoutée dans l'économie, n'est pas sans risques. Les potentiels préjudices causés par les décisions algorithmiques comprennent, par exemple, l'embauche discriminatoire et les condamnations biaisées dans les procédures pénales. Les gouvernements et les entreprises doivent peser le pour (ex. les gains d'efficacité et de productivité) et le contre (ex. institutionnalisation de processus décisionnels opaques non-inclusifs) de l'utilisation de l'IA. En retour, il nous incombe, en tant que citoyens, d'exiger des mécanismes institutionnels et citoyens qui encourageraient le développement de l'IA, tout en offrant des garanties éthiques et des correctifs qui minimiseraient les dommages sociétaux.

Nous avons tous intérêt à assurer une utilisation éthique et responsable de ces technologies, alors comment exiger que les développeurs et les exécutants se plient à une telle responsabilité sociale ? Face à cette prise de conscience collective, un dialogue ouvert est nécessaire ; des discussions participatives doivent permettre aux décideurs de prendre conscience des préoccupations citoyennes.

Lors de la première version des "déjeuners virtuels" organisés par l'Institut Edgelands, nous avons donc initié la mise en place d'un espace de dialogue et d'interactions. Ceci renvoie à l'un des objectifs de l'institut: créer des espaces d'échange, de communication, et construire des ponts pour rapprocher les acteurs de nos discussions. Ainsi, Sandra Cortesi, directrice de la Mission d'experts, a orchestré un véritable dialogue ouvert. Après avoir présenté le mandat de la mission, différentes personnalités de la société civile et du milieu universitaire ont fait connaître leurs positions. Notre mission de facilitation des échanges a donc été complétée.

Les nouvelles technologies ont toujours fait face à une certaine réticence et résistance de la part de la société : la machine à vapeur, l'électricité, les ordinateurs et l'Internet, considérés de "mode passagère", étaient autrefois rejetés d'emblée, leurs risques plus que leurs avantages étant mis en évidence. La méfiance à l'égard de l'inconnu est donc naturelle ; il est complexe d'appréhender ces technologies avec un esprit critique, de comprendre leur ancrage, de peser leurs coûts et leurs avantages. Inciter nos participants à faire de la sorte nous permet de garantir que les technologies employées aujourd'hui et à l'avenir seront bénéfiques et non nuisibles à la société. Alors, parmi la cacophonie des positions et arguments existants, Edgelands souhaite harmoniser et rassembler des opinions informées, fondées sur la science et autres preuves, et socialement responsables.

Références

Kim, H., Giacomin, J. et Macredie, R. (2014). A qualitative study of stakeholders' perspectives on the social network service environment.International Journal of Human-Computer Interaction, 30(12), 965-976.

O'Neil, C. (2017). Armes de destruction mathématique : Comment le big data accroît les inégalités et menace la démocratie. Broadway Books.

.png)

.jpg)